Deux manières de construire un voicebot IA : stitching versus realtime

La manière dont un voicebot IA traite la parole détermine s’il sonne naturel ou au contraire saccadé et peu fiable. Il existe actuellement deux architectures en circulation auprès des développeurs, et le choix entre elles a des conséquences sur l’expérience d’appel, la fiabilité du système et ce que le bot peut extraire d’une conversation. L’approche plus ancienne enchaîne trois composants distincts, tandis que la méthode plus récente traite l’ensemble de la conversation en une seule fois.

L’approche classique : stitching

Quand les premiers voicebots ont été construits, il était logique de chaîner trois composants existants. La parole entrante passait par un moteur de reconnaissance vocale qui en faisait du texte, puis un modèle de langage lisait ce texte et formulait une réponse, et enfin un moteur de synthèse vocale convertissait cette réponse en parole audible. Cette architecture s’appelle « stitching » dans le secteur, parce que vous assemblez trois systèmes indépendants en une seule chaîne.

Pendant un temps, cette approche a livré des résultats utilisables, et pour les équipes qui ne voulaient pas entraîner leur propre modèle de parole, c’était la seule route pratique. Cependant, trois points faibles surgissent dans la pratique, car chaque maillon peut dysfonctionner indépendamment. La reconnaissance vocale peut mal entendre une phrase, le modèle de langage peut donner une réponse lente ou inexacte, et la synthèse vocale peut tomber en panne au mauvais moment. Beaucoup d’équipes intègrent donc une sauvegarde avec un fournisseur de synthèse ou de modèle alternatif, afin que le bot continue à fonctionner en cas de défaillance. Cela résout la panne, mais les appelants entendent soudainement une voix totalement différente et deviennent confus quant à la personne avec laquelle ils parlent vraiment.

Le deuxième inconvénient est peut-être encore plus lourd. En stitching, le modèle de langage ne voit qu’une transcription textuelle, ce qui signifie qu’il ne peut pas percevoir le ton, le volume, l’hésitation et l’émotion de l’appelant. Un client irrité et un client satisfait sonnent identiques pour le modèle dès que leurs paroles apparaissent sur papier, ce qui nuit à la sensibilité contextuelle qui rend une conversation précieuse. Les signaux concernant l’âge apparent, la langue maternelle ou l’humeur se perdent lors de la conversion en texte, alors que ce sont justement ces signaux qui dictent souvent comment un agent conduirait l’appel.

La nouvelle approche : un seul modèle de parole en temps réel

Depuis qu’OpenAI a mis à disposition gpt-realtime-1.5 le 24 février 2026, il existe une deuxième façon de construire des voicebots qui fonctionne mieux dans la plupart des cas. Au lieu de trois composants distincts enchaînés, un seul modèle entend et parle directement, ce qui supprime la couche intermédiaire complète de transcription et de synthèse. Le modèle comprend les mots, le ton et l’émotion de l’appelant simultanément, de sorte qu’il peut ajuster directement sa réponse en conséquence. Une démonstration de Charlierguo montre bien la fluidité avec laquelle cela fonctionne en pratique.

Cela apporte des avantages concrets dans l’utilisation quotidienne. Il n’y a plus qu’un seul point où quelque chose peut dysfonctionner au lieu de trois, ce qui réduit considérablement le risque de panne. Le temps de réaction tourne généralement autour de 400 millisecondes, de sorte que la conversation se déroule naturellement sans le délai qui surgit en stitching. Le multilinguisme est intégré, ce qui permet au même modèle de basculer sans effort entre le français, l’anglais, l’allemand et d’autres langues sans que vous ayez à configurer ce changement à l’avance. Et parce que le modèle traite l’audio plutôt que le texte, il reconnaît un client irrité à sa voix et peut le transférer directement à un agent sans qu’un mot-clé ou une escalade explicite soit nécessaire.

Quand le stitching est encore le bon choix

Il reste une niche où l’architecture plus ancienne s’adapte mieux, et ce sont les situations où aucune conversation en direct n’est nécessaire mais plutôt un enregistrement est analysé après coup. Quand un centre d’appels veut faire résumer, coder ou examiner les appels pour la conformité, il n’y a aucune exigence de latence et vous pouvez tranquillement choisir un modèle de langage spécialisé. Pensez à un modèle médical qui reconnaît les abréviations et termes spécialisés en soins de santé, ou à un moteur de reconnaissance vocale spécialement entraîné sur un dialecte régional. Dans ces scénarios, la précision sur ce seul élément prime sur l’expérience globale de la conversation, car aucun appelant n’attend une réponse en ligne.

Notre recommandation

Pour les entreprises qui veulent conduire des conversations en direct avec un voicebot, nous conseillons dans pratiquement tous les cas l’approche en temps réel. La combinaison d’une réaction plus rapide, d’une sensibilité réduite aux pannes, du multilinguisme sans configuration et de la sensibilité au ton crée une expérience d’appel que les appelants ne perçoivent pas comme robotique. Pour les analyses post-appel et autres scénarios où la précision sur un composant spécifique est déterminante, nous continuons à déployer des architectures de stitching, car elles livrent encore les meilleurs résultats là-bas.

Notre équipe construit les deux architectures

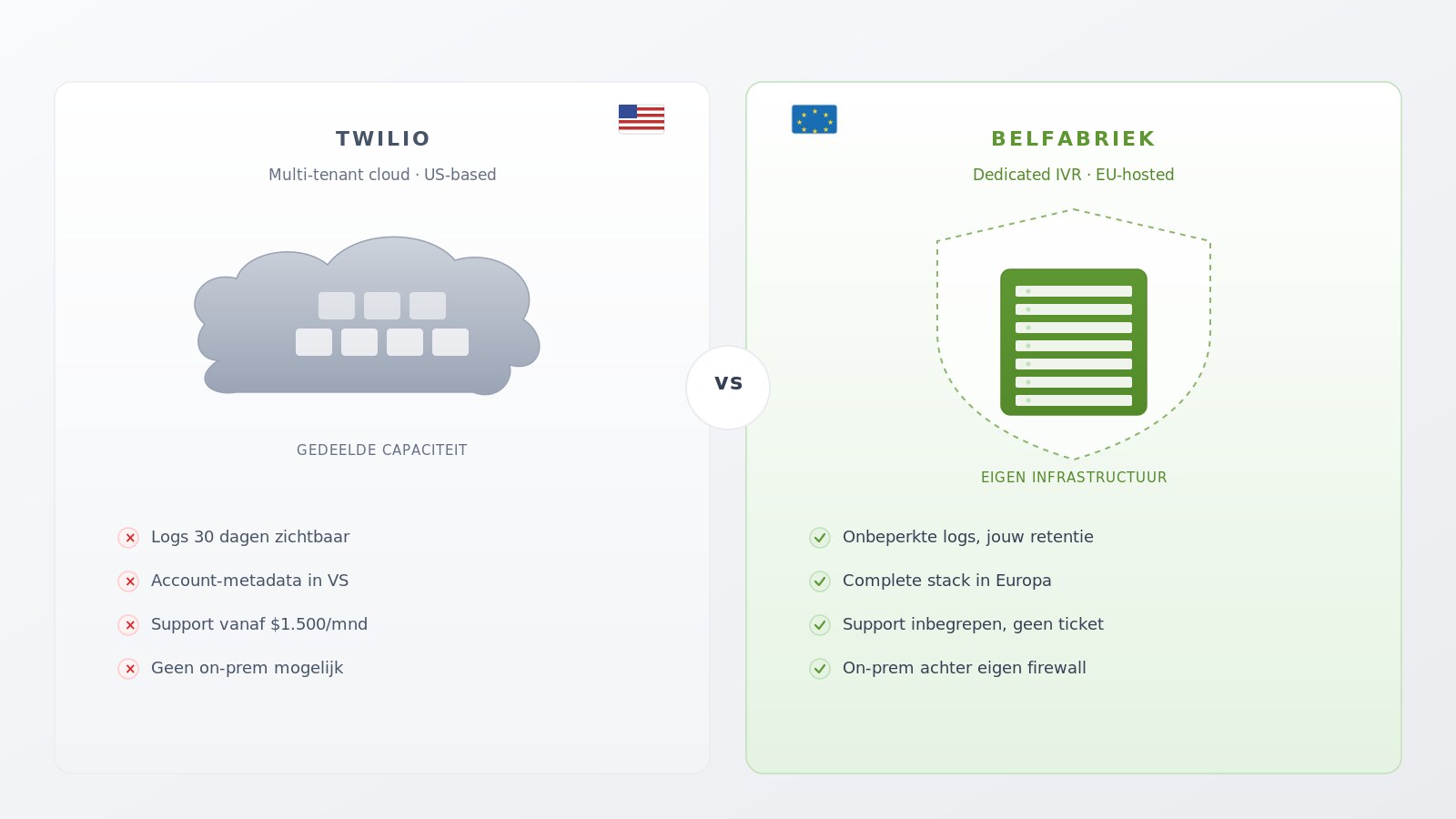

Belfabriek construit des voicebots dans les deux architectures, selon ce qui correspond le mieux à votre flux d’appel. Que vous désiriez une solution entièrement gérée où notre équipe organise tout du début à la fin, ou plutôt un serveur IVR dédié fonctionnant sur votre propre infrastructure, nous livrons des implémentations conformes à la RGPD disponibles 24 heures sur 24, sept jours sur sept.

Mettez-vous en contact avec notre équipe pour discuter de l’architecture qui convient à vos conversations, de la manière dont l’intégration avec vos systèmes existants se déroulera et dans quel délai le voicebot peut être opérationnel. De cette façon, vous obtiendrez une estimation claire de la durée de traitement et de l’investissement, et vous pourrez dès le premier jour faire traiter les appels entrants et sortants par un voicebot qui parle et écoute à un niveau qui était impensable jusqu’à récemment.

Questions fréquemment posées

Le stitching se révèle précieux quand vous n’avez pas besoin de conduire une conversation en direct mais plutôt d’analyser un enregistrement après coup. Vous bénéficiez alors de la liberté de choisir un modèle de langage spécialisé, comme un modèle médical pour la terminologie soignante ou un moteur de reconnaissance vocale entraîné sur un dialecte régional. Dans ces cas, la précision sur un seul élément prime sur la fluidité de la conversation.

Le temps de réaction tourne généralement autour de 400 millisecondes, ce qui se compare à une conversation téléphonique ordinaire entre deux personnes. Puisqu’il n’y a pas de composants distincts enchaînés les uns après les autres, le délai qui surgit en stitching disparaît complètement, si bien que les appelants se rendent rarement compte qu’ils parlent avec une IA.

Oui. Les modèles de parole en temps réel sont entraînés multilingues, ce qui leur permet de basculer pendant la même conversation entre le français, l’anglais, l’allemand et d’autres langues sans que vous n’ayez à configurer ce changement à l’avance. Pour une entreprise avec une clientèle internationale, une étape de configuration entière disparaît ainsi.

Nous intégrons une route de secours sur chaque projet, de sorte que l’appel est automatiquement transféré à un agent ou vers un message préenregistré en cas de défaillance. L’appelant remarque uniquement que l’appel change de route, ce qui signifie que votre flux d’appel reste intact même en cas de perturbation chez le fournisseur.

Oui. Nous configurons le voicebot de façon que l’audio et les métadonnées restent au sein de l’Union européenne et qu’une convention de traitement des données lie toutes les parties impliquées. Pour les secteurs réglementés comme la santé, les banques et les assurances, nous proposons également une variante auto-hébergée qui s’exécute entièrement derrière votre propre pare-feu.